AI

Legge UE sull’intelligenza artificiale ufficialmente in vigore

Da giovedì 1° agosto 2024, entra ufficialmente in vigore la nuova regolamentazione dell’Unione Europea sull’intelligenza artificiale (IA), basata su un approccio al rischio. Questa legge e il suo avvio impone una serie di scadenze di conformità per sviluppatori e applicazioni di IA, con la maggior parte delle disposizioni operative entro metà 2026. Tuttavia, la prima scadenza significativa, che vieta l’uso di dati biometrici remoti da parte delle forze dell’ordine in luoghi pubblici, entra in vigore tra sei mesi.

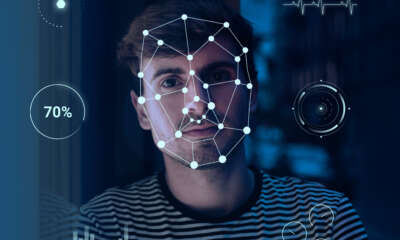

L’approccio europeo distingue tra applicazioni IA a basso, medio e alto rischio. Le applicazioni a basso o nullo rischio non saranno soggette a regolamentazione. Quelle ad alto rischio, come la biometria e il riconoscimento facciale, dovranno essere registrate in un database dell’UE e gli sviluppatori dovranno rispettare rigorosi obblighi di gestione del rischio e della qualità. Per tecnologie come chatbot e strumenti per la creazione di deepfake, considerate a rischio limitato, saranno necessari requisiti di trasparenza per evitare che gli utenti siano ingannati.

Sanzioni e adempimenti di legge

Le sanzioni variano in base alla gravità delle violazioni: fino al 7% del fatturato annuo globale per violazioni gravi, fino al 3% per altre infrazioni e fino all’1,5% per la fornitura di informazioni errate. Gli sviluppatori di IA a uso generale (GPAI) affronteranno requisiti di trasparenza più leggeri, ma i modelli più potenti saranno soggetti a valutazioni e mitigazioni del rischio.

L’AI Office dell’UE ha avviato consultazioni per definire i Codici di condotta, previsti per l’aprile 2025. OpenAI ha annunciato l’intenzione di collaborare strettamente con l’UE e altre autorità per implementare la nuova legge, preparando documentazione tecnica e linee guida per i fornitori e utilizzatori dei suoi modelli.

OpenAI consiglia agli sviluppatori di classificare i propri sistemi IA per determinare gli obblighi di conformità e di consultare un consulente legale per questioni complesse. La nuova leggesegna un passo significativo verso la regolamentazione delle tecnologie emergenti. Con un approccio mirato basato sul rischio, la normativa prevede scadenze di conformità per diversi settori, distinguendo tra applicazioni a basso rischio e quelle ad alto rischio come la biometria e il riconoscimento facciale.

Le disposizioni della legge mirano a garantire la sicurezza e la trasparenza nell’uso dell’IA, imponendo obblighi rigorosi ai sviluppatori per la gestione del rischio e la qualità. Le sanzioni differenziate, fino al 7% del fatturato per gravi violazioni, riflettono l’importanza di una conformità scrupolosa.

La consultazione aperta avviata dall’AI Office dell’UE rivela un impegno per sviluppare linee guida chiare e garantire una transizione fluida verso l’implementazione completa della normativa. Le organizzazioni sono incoraggiate a prepararsi, valutando attentamente l’impatto delle nuove regole sui propri sistemi AI.